GPT Image 2 から HappyHorse へ:画像から動画を安定させる実用ワークフロー

GPT Image 2 で先頭フレームと参照画像を固めてから、HappyHorse で短尺動画にするための実践的な手順です。

HappyHorse をうまく使うコツは、いきなり動画プロンプトを書き始めないことです。

HappyHorse-1.0 は、公開されている AI 動画ランキングで目立つ存在になっています。ただ、どれだけ強い動画モデルでも、最初の視覚設計が曖昧だと結果は不安定になります。先頭フレームが弱い、商品形状が違う、キャラクターの見た目がぶれる。そうした問題は、動きを付けても直りません。むしろ動画になることで、より目立ちます。

そこで有効なのが、GPT Image 2 から HappyHorse へつなぐ流れです。まず GPT Image 2 で静止画を作り込み、承認できる先頭フレームを作る。その上で HappyHorse に渡して、短尺動画として動かします。

まず押さえるべき考え方

動画の成否が「正確な見た目」に依存するなら、先に GPT Image 2 を使うべきです。

- 商品ローンチのファーストフレーム

- ブランド広告のメインビジュアル

- EC 商品ページのモーション素材

- キャラクターやマスコットの紹介

- TikTok / Reels / Shorts 向け広告の冒頭カット

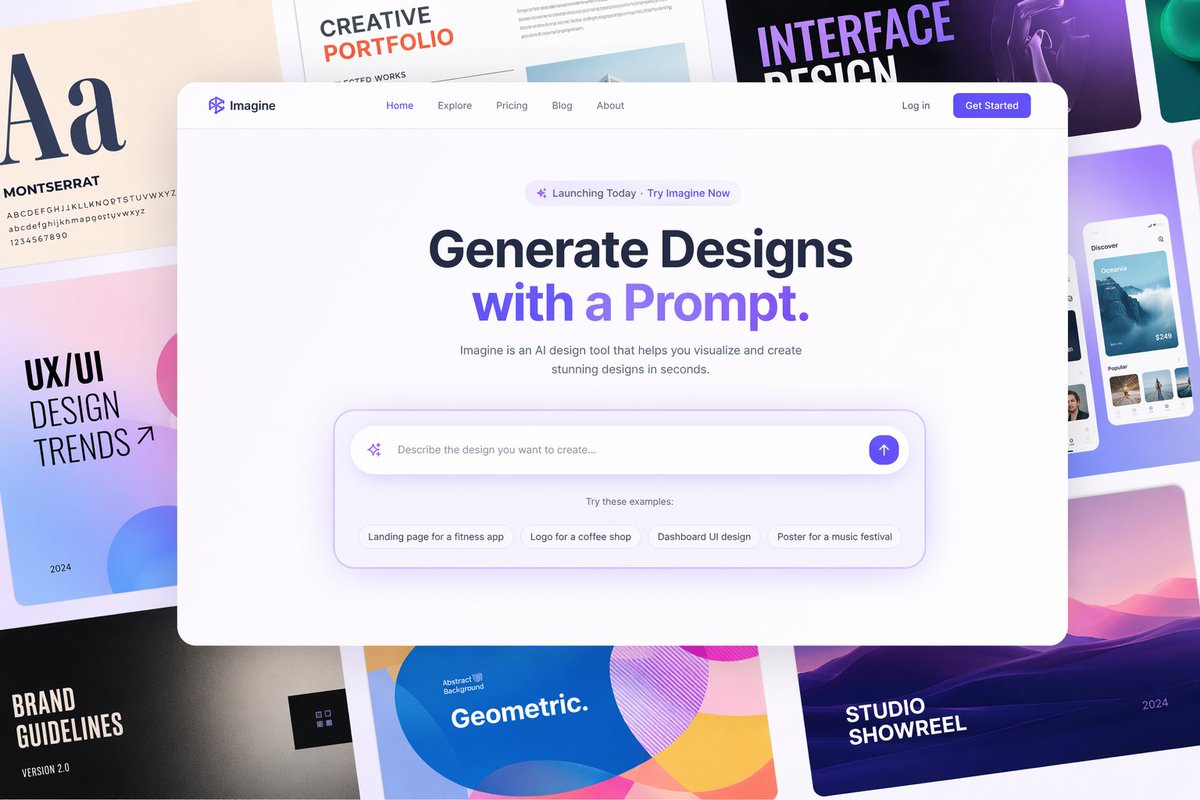

- アプリや SaaS のデモ画面

- ストーリーボードのキーフレーム

基本の流れは次の通りです。

- 動画の用途と配信先を先に決める。

- GPT Image 2 ワークスペース でキーフレームを作る。

- 商品、人物、構図、文字の問題を画像の段階で直す。

- その画像を Happy Horse 1.0 の先頭フレームまたは参照画像として使う。

- HappyHorse では、見た目よりも動き、カメラ、テンポ、維持すべき要素を指示する。

- 短いバリエーションを数本出し、動きと一貫性が最も良いものを選ぶ。

HappyHorse が今注目される理由

2026 年 4 月 28 日時点で、Artificial Analysis Text to Video leaderboard は HappyHorse-1.0 を音声なし text-to-video 部門の 1 位として表示しており、表示上の Elo は 1,366 です。Image to Video leaderboard でも、音声なし image-to-video 部門で 1 位、表示上の Elo は 1,402 です。

この数値は投票によって変わるため、永続的な順位ではなく、その時点のスナップショットとして見る必要があります。

また、2026 年 4 月 27 日には fal が HappyHorse-1.0 の開発者・企業向け API アクセスを発表しました。image-to-video、reference-to-video、text-to-video、video-edit のエンドポイントが含まれます。つまり、話題性だけでなく、実際に試せる制作フローとしても見え始めています。

GPTIMG2 AI のユーザーにとって重要なのは、HappyHorse の image-to-video 活用です。画像入力の動画化が強いなら、渡す画像の品質が結果を大きく左右します。

いきなり text-to-video から始めない方がよい場面

Text-to-video は、まだ方向性が固まっていないアイデア出しには向いています。一方で、商品、キャラクター、画面構成、ブランド表現を守る必要がある場合は不安定になりやすいです。

商品広告では、ボトルの形やラベルが変わると使えません。キャラクター動画では、顔や衣装が途中で変わるとブランド資産として弱くなります。SaaS のランディングページ動画では、画面構成が先に整理されていないと、動画化しても説得力が出ません。

GPT Image 2 を先に使うと、動画生成の前に次の要素を確認できます。

- 主体の見た目とシルエット

- 商品形状、ラベル、質感

- キャラクターの顔、服装、比率

- 構図、余白、トリミング

- 光の方向と色設計

- テキストの階層

- 最初の 1 秒の引き

静止画として成立してから HappyHorse に渡す方が、動画側の失敗を減らしやすくなります。

良い GPT Image 2 の静止画は、動画モデルに明確な主体、構図、商品ストーリーを渡します。

GPT Image 2 で先頭フレームを作る

GPT Image 2 ワークスペース を開き、最終的に先頭フレームまたは主な参照画像になる静止画を作ります。

基本のプロンプト構造は次の通りです。

Create a [format] still image for [campaign or use case].

The subject is [specific product, character, object, or scene].

The final video will be [duration, channel, and motion goal].

Design the frame so it works as the first frame of an AI video.

Preserve clear subject identity, strong composition, realistic lighting, and enough space for motion.

Do not add extra products, random text, distorted logos, or background clutter.商品 teaser なら、こう具体化できます。

Create a vertical 9:16 first-frame image for a 5-second product teaser.

The subject is a premium orange juice bottle on a chilled studio surface with condensation.

The final video will show a slow camera push-in, soft citrus slices moving in the background, and bright morning light.

Make the bottle shape, label area, cap, and glass texture clear.

Leave space around the bottle for subtle motion.

Do not add discount badges, extra bottles, unreadable text, hands, or unrelated props.静止画の時点で弱いなら、動画に進まない方がよいです。画像で直せる問題は、画像の段階で直します。

動画化する前に確認すること

HappyHorse に渡す前に、次の観点で画像を見直します。

- 主体はすぐに認識できるか

- 最終チャネルに合った比率か

- 商品、画面、文字に破綻がないか

- 動きの余白があるか

- 光や色の方向性が一貫しているか

- 最初の 1 秒で視線を止められるか

ここで引っかかるなら、GPT Image 2 に戻って調整します。動画生成を、弱い画像の修理工程にしないことが重要です。

HappyHorse では「動き」を書く

画像が決まったら、Happy Horse 1.0 に移ります。この段階では、見た目をもう一度細かく説明するより、時間の中で何が起きるかを指示します。

Animate the uploaded first frame into a [duration] video.

Keep the subject identity, composition, product shape, color palette, and lighting consistent.

Motion: [camera movement, subject movement, background movement].

Pace: [slow, medium, energetic, smooth].

Style: [realistic product video, cinematic social ad, clean landing-page loop].

Avoid: [warping, extra objects, text changes, face drift, logo changes].商品動画なら、例えばこう書けます。

Animate the uploaded first frame into a 5-second vertical product teaser.

Keep the bottle shape, label area, cap, orange color, condensation, and studio lighting consistent.

Use a slow dolly push-in toward the bottle.

Add subtle movement in the background: soft citrus slices drifting slightly and gentle light shimmer on the glass.

Keep the motion premium, clean, and realistic.

Avoid extra bottles, label changes, distorted text, sudden camera jumps, or liquid spilling.比率と長さは配信先から決める

GPTIMG2 AI の HappyHorse は、3〜15 秒の短尺動画、720p / 1080p、16:9、9:16、1:1、4:3、3:4 などの比率に対応します。

| 用途 | 推奨設定 | 理由 |

|---|---|---|

| TikTok / Reels / Shorts | 9:16、5〜8 秒 | 縦画面で最初のフレームが重要 |

| ランディングページのメイン動画 | 16:9、5〜10 秒 | 横長構成とコピー余白に合う |

| 商品ページ | 1:1 または 4:3、4〜6 秒 | ギャラリーや商品モジュールに入れやすい |

| 広告バリエーション | 4:5 または 9:16、3〜6 秒 | 複数の冒頭案を検証しやすい |

| ストーリーボード検証 | 目標比率で 3〜5 秒 | まず動きの方向を確認できる |

最初から長く作る必要はありません。短い動画の方が、失敗理由を見つけやすくなります。

画面デザインやランディングページ動画では、先に GPT Image 2 でレイアウトを固め、HappyHorse では控えめな動きを足す方が安定します。

GPTIMG2 AI でのつなぎ方

GPTIMG2 AI では、この流れをそのまま使えます。

- GPT Image 2 ワークスペース で先頭フレームや参照画像を作る。

- GPT Image 2 プロンプトライブラリ で、より使いやすい画像プロンプトの型を探す。

- Happy Horse 1.0 で、承認済み画像を短尺動画にする。

GPT Image 2 は視覚設計を担当します。HappyHorse は動きの設計を担当します。この役割分担があるだけで、text-to-video だけに任せるより結果を判断しやすくなります。

まとめ

HappyHorse は、現在の動画ランキングで注目に値するモデルです。ただし、実務で本当に効く問いは「HappyHorse がすごいか」ではなく、「HappyHorse にどんな入力を渡すか」です。

多くのクリエイターやマーケティングチームにとって、答えは明快です。

GPT Image 2 で、動かす価値のあるフレームを作る。そこから HappyHorse で動画にする。

HappyHorse は GPT Image 2 より優れていますか?

比較する対象が違います。GPT Image 2 は画像生成と編集のためのモデルです。HappyHorse は動画生成のためのモデルです。実用上は、GPT Image 2 を先頭フレームや参照画像の準備に使い、HappyHorse で動かすのが自然です。

HappyHorse では text-to-video と image-to-video のどちらを使うべきですか?

自由にアイデアを探るなら text-to-video。商品、人物、構図、先頭フレームを安定させたいなら image-to-video が向いています。