从 GPT Image 2 到 HappyHorse:更稳的图生视频工作流

先用 GPT Image 2 做好首帧和参考图,再用 HappyHorse 生成短视频。适合产品广告、角色短片、SaaS 落地页和社媒素材。

真正好用的 HappyHorse 工作流,通常不是从视频提示词开始,而是从一张足够清楚的图开始。

HappyHorse-1.0 最近很热,原因很直接:它在公开 AI 视频榜单上的表现非常靠前。但视频模型再强,也需要一个可靠的视觉起点。如果首帧已经含糊、产品外形不准、角色设计漂移,或者广告构图本身就站不住,后面的运动不会自动修好它,只会把问题“动起来”。

所以这篇文章不做生硬的 GPT Image 2 vs HappyHorse。更实用的方向是:先用 GPT Image 2 把要动起来的画面做对,再用 HappyHorse 把这张已确认的图变成短视频。

先看结论

只要视频结果依赖一个明确的视觉基础,就应该先用 GPT Image 2:

- 产品发布短片的第一帧

- 品牌广告的主视觉

- 电商详情页里的动态商品图

- 角色或 IP 的开场镜头

- TikTok / Reels / Shorts 的广告开场

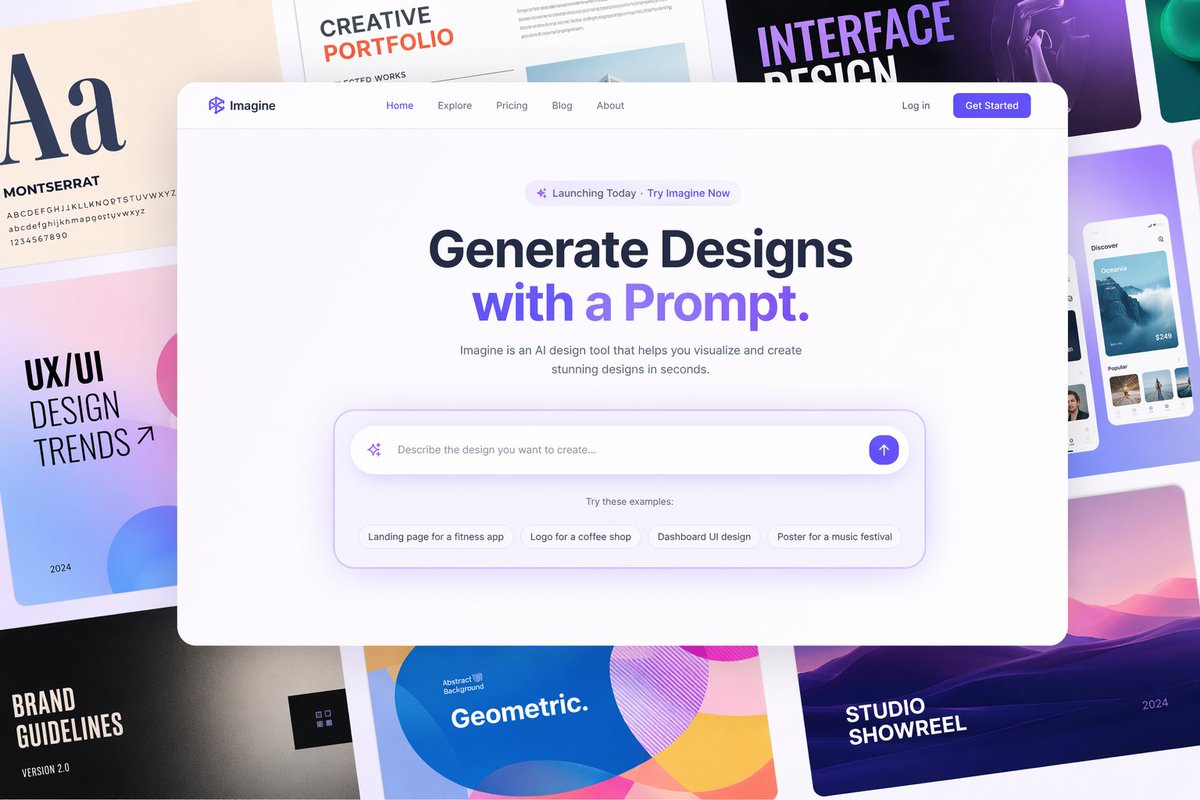

- App 或 SaaS 的演示画面

- 分镜脚本里的关键帧

推荐流程很简单:

- 先写清楚视频要服务的渠道和目标。

- 在 GPT Image 2 工作区 生成关键静帧。

- 趁它还是图片时,修正产品、角色、构图和文字问题。

- 把这张图作为首帧或参考图放进 Happy Horse 1.0。

- 视频提示词只写运动、镜头、节奏和需要保持不变的内容。

- 先生成 2-3 个短版本,再挑动作和连续性最好的结果。

为什么现在可以蹭 HappyHorse 的热度

截至 2026 年 4 月 28 日,Artificial Analysis Text to Video 榜单显示 HappyHorse-1.0 在无音频 text-to-video 分类中排名第一,可见 Elo 为 1,366。Image to Video 榜单也显示 HappyHorse-1.0 在无音频 image-to-video 分类中排名第一,可见 Elo 为 1,402。

这些分数会随着投票继续变化,所以更准确的说法是:这是当前榜单快照,不是永久结论。

可用性也在变清楚。2026 年 4 月 27 日,fal 宣布为 HappyHorse-1.0 提供开发者和企业 API 访问,覆盖 image-to-video、reference-to-video、text-to-video 和 video-edit。也就是说,它已经不只是社媒上被讨论的“神秘模型”,而是创作者和开发者可以通过 API 合作方实际测试的模型。

对 GPTIMG2 AI 来说,最值得抓住的是 image-to-video 这条线:如果 HappyHorse 擅长把视觉输入变成视频,那输入图本身的质量就会直接影响视频结果。

为什么不要一上来就 text-to-video

Text-to-video 很适合开放探索,但不适合所有生产任务。

产品广告不能随便改变瓶身形状。角色短片不能中途换脸、换衣服。SaaS 落地页视频不能基于一个还没确定的 UI 草图直接动画。品牌广告也不能接受随机字体、无关道具和不稳定的视觉情绪。

GPT Image 2 的作用,是在进入视频生成前给你一个可审核的视觉检查点。

你可以先锁定:

- 主体身份和轮廓

- 产品形状、标签和材质

- 角色脸、服装和比例

- 构图、裁切和留白

- 光线方向和色彩系统

- 广告文字层级

- 第一秒是否足够抓人

静帧过关以后,HappyHorse 才有一个更明确的目标去做运动。

一张好的 GPT Image 2 静帧,会先把主体、构图和产品叙事定下来,再交给视频模型添加运动。

从 GPT Image 2 到 HappyHorse 的完整流程

把它当成一个小型生产流程,而不是一个超长万能提示词。

1. 先定义视频要完成什么任务

先别急着写“电影感”“高级”“真实”。这些词太宽泛,不方便判断成片是否成功。

更好的简报应该像这样:

5 秒竖版产品发布预热视频16:9 的 SaaS 落地页首屏视频护肤品创作者广告开场镜头品牌角色的 5 秒介绍短片电商详情页里的产品动效循环

用途越清楚,GPT Image 2 生成首帧时越容易确定构图,HappyHorse 做视频时也越容易控制运动。

2. 用 GPT Image 2 生成首帧

打开 GPT Image 2 工作区,先生成将来要作为首帧或主参考图的图片。

可以用这个英文提示词结构:

Create a [format] still image for [campaign or use case].

The subject is [specific product, character, object, or scene].

The final video will be [duration, channel, and motion goal].

Design the frame so it works as the first frame of an AI video.

Preserve clear subject identity, strong composition, realistic lighting, and enough space for motion.

Do not add extra products, random text, distorted logos, or background clutter.如果你要做产品短片,可以这样改:

Create a vertical 9:16 first-frame image for a 5-second product teaser.

The subject is a premium orange juice bottle on a chilled studio surface with condensation.

The final video will show a slow camera push-in, soft citrus slices moving in the background, and bright morning light.

Make the bottle shape, label area, cap, and glass texture clear.

Leave space around the bottle for subtle motion.

Do not add discount badges, extra bottles, unreadable text, hands, or unrelated props.不要在静帧还不成立时进入视频阶段。图都不对,视频只会更难修。

3. 动画前先审核静帧

进入 HappyHorse 之前,先问几个很实际的问题:

- 主体是否一眼能看懂?

- 裁切是否适合最终渠道?

- 产品、UI 或文字有没有明显错误?

- 画面是否留出了运动空间?

- 光线方向是否统一?

- 第一秒有没有足够强的视觉吸引力?

- 背景道具是否会在视频里变得奇怪?

如果答案不理想,先回到 GPT Image 2 修改图片。不要把视频生成当成修图工具。

4. 把图放进 HappyHorse,再写运动提示词

静帧确认以后,打开 Happy Horse 1.0。这时不要把图片细节再完整复述一遍,重点要从“画面长什么样”切换到“接下来发生什么”。

可以用这个结构:

Animate the uploaded first frame into a [duration] video.

Keep the subject identity, composition, product shape, color palette, and lighting consistent.

Motion: [camera movement, subject movement, background movement].

Pace: [slow, medium, energetic, smooth].

Style: [realistic product video, cinematic social ad, clean landing-page loop].

Avoid: [warping, extra objects, text changes, face drift, logo changes].产品场景可以这样写:

Animate the uploaded first frame into a 5-second vertical product teaser.

Keep the bottle shape, label area, cap, orange color, condensation, and studio lighting consistent.

Use a slow dolly push-in toward the bottle.

Add subtle movement in the background: soft citrus slices drifting slightly and gentle light shimmer on the glass.

Keep the motion premium, clean, and realistic.

Avoid extra bottles, label changes, distorted text, sudden camera jumps, or liquid spilling.5. 按投放渠道选比例和时长

HappyHorse 在 GPTIMG2 AI 中支持 3-15 秒短视频、720p 或 1080p 输出,以及 16:9、9:16、1:1、4:3、3:4 等常见比例。

可以这样选:

| 场景 | 建议设置 | 原因 |

|---|---|---|

| TikTok / Reels / Shorts | 9:16,5-8 秒 | 竖屏、节奏快,首帧要强 |

| 落地页首屏视频 | 16:9,5-10 秒 | 更适合宽屏和文案留白 |

| 电商详情页 | 1:1 或 4:3,4-6 秒 | 适合商品模块和图库 |

| 付费广告变体 | 4:5 或 9:16,3-6 秒 | 方便快速测试不同开场 |

| 分镜验证 | 任意目标比例,3-5 秒 | 先验证运动方向,不急着拉长 |

不要一开始就默认最长时长。短片更容易控制,也更容易判断失败原因。

三个最适合的使用场景

产品发布预热视频:先用 GPT Image 2 做干净的产品首帧,再让 HappyHorse 做慢推镜头、背景微动和光线变化。

角色或品牌 IP:先把角色脸、服装、比例和色彩定下来,再让 HappyHorse 做轻微转身、挥手或镜头推进。

SaaS 落地页视频:先用 GPT Image 2 做 UI 或数据看板画面,再让 HappyHorse 做轻微视差、卡片高亮或光效流动,不要让它重画整个界面。

UI 和落地页视频要先用 GPT Image 2 定好布局,再让 HappyHorse 添加克制的运动。

在 GPTIMG2 AI 里怎么接起来

这个流程在 GPTIMG2 AI 里可以自然完成:

- 用 GPT Image 2 工作区 生成首帧或参考图。

- 用 GPT Image 2 提示词库 找更成熟的图片提示词结构。

- 用 Happy Horse 1.0 把确认后的图片变成视频。

GPT Image 2 负责视觉决策,HappyHorse 负责运动决策。两者组合,比把所有压力都交给 text-to-video 更稳。

最终结论

HappyHorse 值得关注,是因为它当前在视频榜单上的位置很显眼。但真正影响成片质量的问题是:你给它什么输入。

对大多数创作者和营销团队来说,最稳的答案是:

先用 GPT Image 2 做出值得动起来的画面,再用 HappyHorse 把它动起来。

HappyHorse 比 GPT Image 2 更好吗?

不是同一类工具。GPT Image 2 用来生成和编辑图片,HappyHorse 用来生成视频。更合理的用法是把 GPT Image 2 当作首帧和参考图步骤,再用 HappyHorse 做运动。

HappyHorse 应该用 text-to-video 还是 image-to-video?

开放探索可以用 text-to-video。产品、角色、构图或首帧需要稳定时,用 image-to-video 更合适。

GPT Image 2 能给 HappyHorse 做首帧吗?

可以。GPT Image 2 很适合生成产品静帧、广告主视觉、角色设计、UI 概念和其他视频参考图。

目录

- 先看结论

- 为什么现在可以蹭 HappyHorse 的热度

- 为什么不要一上来就 text-to-video

- 从 GPT Image 2 到 HappyHorse 的完整流程

- 1. 先定义视频要完成什么任务

- 2. 用 GPT Image 2 生成首帧

- 3. 动画前先审核静帧

- 4. 把图放进 HappyHorse,再写运动提示词

- 5. 按投放渠道选比例和时长

- 三个最适合的使用场景

- 在 GPTIMG2 AI 里怎么接起来

- 最终结论

- HappyHorse 比 GPT Image 2 更好吗?

- HappyHorse 应该用 text-to-video 还是 image-to-video?

- GPT Image 2 能给 HappyHorse 做首帧吗?