GPT Image 2에서 HappyHorse까지: 이미지-투-비디오를 더 안정적으로 만드는 워크플로

GPT Image 2로 첫 프레임과 참조 이미지를 먼저 확정한 뒤, HappyHorse로 짧은 영상을 만드는 실전 워크플로입니다.

HappyHorse를 잘 쓰는 방법은 영상 프롬프트를 바로 쓰는 것이 아닙니다. 먼저 움직일 가치가 있는 이미지를 만드는 것입니다.

HappyHorse-1.0은 공개 AI 영상 리더보드에서 눈에 띄는 성과를 보이며 주목받고 있습니다. 하지만 영상 모델이 아무리 강해도 출발 이미지가 약하면 결과는 흔들립니다. 첫 프레임이 모호하거나, 제품 형태가 틀리거나, 캐릭터 디자인이 불안정하면 모션은 그 문제를 고치지 않습니다. 오히려 더 잘 보이게 만듭니다.

그래서 이 글의 핵심은 GPT Image 2 vs HappyHorse가 아닙니다. 더 실용적인 접근은 GPT Image 2로 정지 이미지를 먼저 완성하고, HappyHorse로 그 이미지를 움직이는 것입니다.

핵심 요약

영상 결과가 정확한 시각 기반에 달려 있다면 GPT Image 2를 먼저 쓰는 편이 좋습니다.

- 제품 출시 티저의 첫 프레임

- 브랜드 광고의 메인 비주얼

- 이커머스 상품 장면

- 캐릭터 또는 마스코트 인트로

- TikTok, Reels, Shorts용 광고 첫 장면

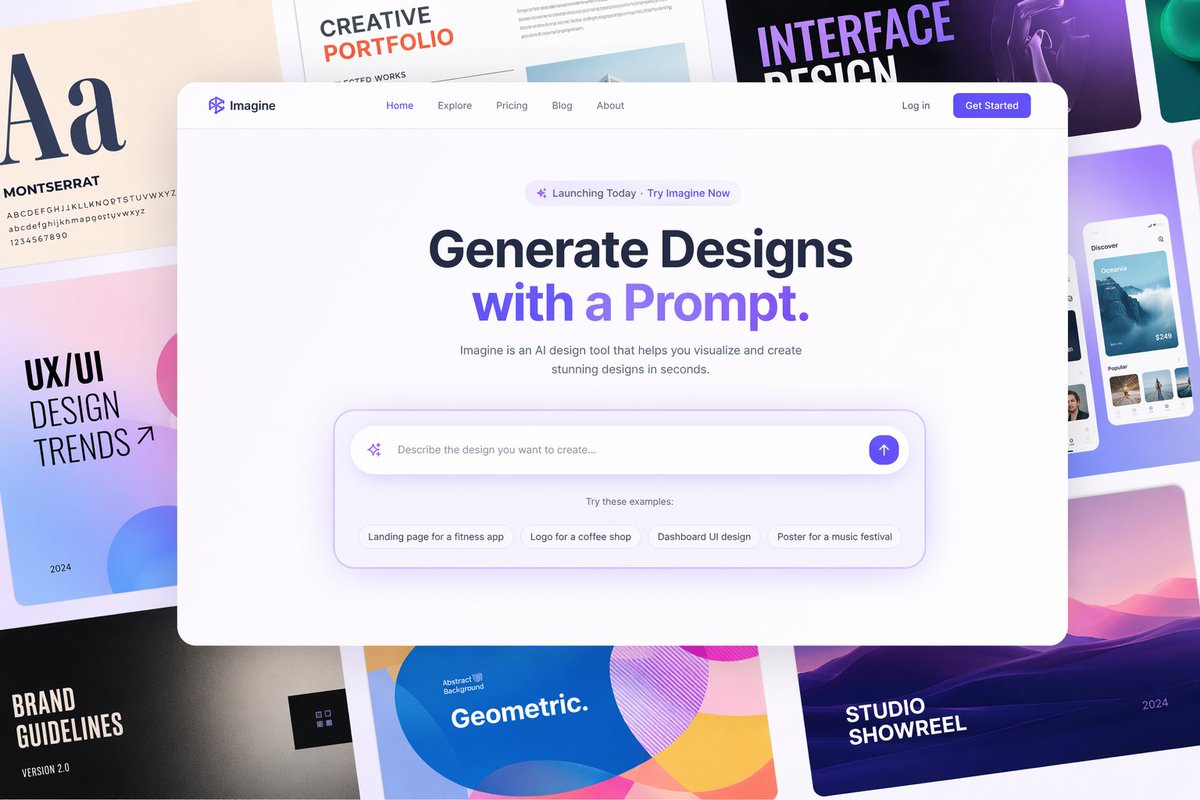

- 앱 또는 SaaS 데모 화면

- 스토리보드용 키프레임

추천 흐름은 다음과 같습니다.

- 영상의 채널과 목표를 먼저 정합니다.

- GPT Image 2 워크스페이스에서 핵심 정지 이미지를 만듭니다.

- 제품, 캐릭터, 구도, 텍스트 문제를 이미지 단계에서 수정합니다.

- 이 이미지를 Happy Horse 1.0의 첫 프레임 또는 참조 이미지로 사용합니다.

- HappyHorse 프롬프트에서는 모션, 카메라, 속도, 유지해야 할 요소를 중심으로 씁니다.

- 짧은 버전을 2~3개 생성한 뒤 움직임과 연속성이 가장 좋은 결과를 선택합니다.

HappyHorse가 지금 주목받는 이유

2026년 4월 28일 기준 Artificial Analysis Text to Video 리더보드는 HappyHorse-1.0을 무음 text-to-video 부문 1위로 표시하고 있으며, 보이는 Elo는 1,366입니다. Image to Video 리더보드에서도 무음 image-to-video 부문 1위로 표시되며, 보이는 Elo는 1,402입니다.

이 점수는 투표가 누적되면 바뀔 수 있습니다. 따라서 영구적인 사실이 아니라 2026년 4월 28일 기준의 현재 스냅샷으로 보는 것이 맞습니다.

또한 2026년 4월 27일 fal은 HappyHorse-1.0의 개발자 및 기업용 API 접근을 발표했습니다. image-to-video, reference-to-video, text-to-video, video-edit 엔드포인트가 포함됩니다. 즉, HappyHorse는 단순히 소셜에서 화제가 되는 모델을 넘어 실제 제작 흐름에서 테스트할 수 있는 모델로 이동하고 있습니다.

GPTIMG2 AI 사용자에게 중요한 지점은 image-to-video입니다. HappyHorse가 이미지 입력을 잘 영상화한다면, 입력 이미지의 품질은 최종 영상 품질의 핵심 변수가 됩니다.

text-to-video로 바로 시작하지 않는 이유

Text-to-video는 방향이 열려 있는 아이디어 탐색에 좋습니다. 하지만 제품, 캐릭터, 화면 구성, 브랜드 장면을 안정적으로 유지해야 하는 작업에는 위험합니다.

제품 광고에서 병 모양이나 라벨이 바뀌면 사용할 수 없습니다. 캐릭터 영상에서 얼굴이나 의상이 흔들리면 반복 가능한 브랜드 자산이 되기 어렵습니다. SaaS 랜딩 페이지 영상은 먼저 화면 구조가 시각적으로 정리되어 있어야 설득력이 생깁니다.

GPT Image 2를 먼저 쓰면 영상 생성 전에 다음 요소를 확인할 수 있습니다.

- 주체의 실루엣과 정체성

- 제품 형태, 라벨, 재질

- 캐릭터 얼굴, 의상, 비율

- 구도, 여백, 크롭

- 조명 방향과 색상 체계

- 텍스트 위계

- 첫 1초의 시선 장악력

정지 이미지가 먼저 안정되면 HappyHorse가 따라야 할 목표도 훨씬 명확해집니다.

잘 만든 GPT Image 2 정지 이미지는 영상 모델에 더 명확한 주체, 구도, 제품 스토리를 제공합니다.

GPT Image 2로 첫 프레임 만들기

GPT Image 2 워크스페이스를 열고 첫 프레임 또는 주요 참조 이미지가 될 정지 이미지를 만듭니다.

기본 구조는 다음과 같습니다.

Create a [format] still image for [campaign or use case].

The subject is [specific product, character, object, or scene].

The final video will be [duration, channel, and motion goal].

Design the frame so it works as the first frame of an AI video.

Preserve clear subject identity, strong composition, realistic lighting, and enough space for motion.

Do not add extra products, random text, distorted logos, or background clutter.제품 티저라면 이렇게 구체화할 수 있습니다.

Create a vertical 9:16 first-frame image for a 5-second product teaser.

The subject is a premium orange juice bottle on a chilled studio surface with condensation.

The final video will show a slow camera push-in, soft citrus slices moving in the background, and bright morning light.

Make the bottle shape, label area, cap, and glass texture clear.

Leave space around the bottle for subtle motion.

Do not add discount badges, extra bottles, unreadable text, hands, or unrelated props.이미지가 단독으로도 설득력 있어야 다음 단계로 갈 수 있습니다. 정지 이미지가 약하면 영상도 안정되기 어렵습니다.

영상화 전에 이미지 검토하기

HappyHorse로 넘어가기 전에 다음을 확인하세요.

- 주체가 즉시 알아보이는가

- 최종 채널에 맞는 비율인가

- 제품, 화면, 텍스트에 눈에 띄는 오류가 없는가

- 움직일 수 있는 여백이 있는가

- 조명과 색감이 일관적인가

- 첫 1초가 스크롤을 멈추게 할 만큼 강한가

여기서 문제가 보이면 GPT Image 2로 돌아가 이미지를 수정하는 편이 낫습니다. 영상 생성은 약한 이미지를 고치는 단계가 아닙니다.

HappyHorse에서는 모션을 쓰세요

이미지가 확정되면 Happy Horse 1.0으로 이동합니다. 이 단계에서는 이미지의 모든 디테일을 다시 설명하기보다 시간에 따라 무엇이 바뀌는지 써야 합니다.

Animate the uploaded first frame into a [duration] video.

Keep the subject identity, composition, product shape, color palette, and lighting consistent.

Motion: [camera movement, subject movement, background movement].

Pace: [slow, medium, energetic, smooth].

Style: [realistic product video, cinematic social ad, clean landing-page loop].

Avoid: [warping, extra objects, text changes, face drift, logo changes].제품 영상이라면 이렇게 쓸 수 있습니다.

Animate the uploaded first frame into a 5-second vertical product teaser.

Keep the bottle shape, label area, cap, orange color, condensation, and studio lighting consistent.

Use a slow dolly push-in toward the bottle.

Add subtle movement in the background: soft citrus slices drifting slightly and gentle light shimmer on the glass.

Keep the motion premium, clean, and realistic.

Avoid extra bottles, label changes, distorted text, sudden camera jumps, or liquid spilling.화면비와 길이는 채널에서 결정하세요

GPTIMG2 AI의 HappyHorse는 3~15초 길이, 720p 또는 1080p 출력, 16:9, 9:16, 1:1, 4:3, 3:4 같은 화면비를 지원합니다.

| 용도 | 추천 설정 | 이유 |

|---|---|---|

| TikTok / Reels / Shorts | 9:16, 5~8초 | 세로형 피드와 강한 첫 프레임에 적합 |

| 랜딩 페이지 메인 영상 | 16:9, 5~10초 | 넓은 화면과 카피 공간에 적합 |

| 제품 상세 페이지 | 1:1 또는 4:3, 4~6초 | 상품 모듈과 갤러리에 넣기 좋음 |

| 광고 변형 테스트 | 4:5 또는 9:16, 3~6초 | 여러 첫 장면을 빠르게 비교하기 좋음 |

| 스토리보드 검증 | 목표 비율, 3~5초 | 최종 품질보다 모션 방향 확인에 집중 |

처음부터 긴 영상을 만들 필요는 없습니다. 짧게 만들수록 실패 원인을 더 빨리 파악할 수 있습니다.

화면 디자인과 랜딩 페이지 영상은 GPT Image 2로 레이아웃을 먼저 고정하고, HappyHorse로 절제된 움직임을 더하는 방식이 안정적입니다.

GPTIMG2 AI에서 이어 쓰는 방법

GPTIMG2 AI에서는 이 흐름을 그대로 연결할 수 있습니다.

- GPT Image 2 워크스페이스에서 첫 프레임이나 참조 이미지를 만듭니다.

- GPT Image 2 프롬프트 라이브러리에서 더 좋은 이미지 프롬프트 구조를 찾습니다.

- Happy Horse 1.0에서 확정된 이미지를 짧은 영상으로 변환합니다.

GPT Image 2는 시각적 결정을 담당하고, HappyHorse는 모션 결정을 담당합니다. 역할을 나누면 text-to-video 하나에 모든 것을 맡기는 것보다 결과를 검토하기 쉽습니다.

결론

HappyHorse는 현재 영상 리더보드에서 눈에 띄는 모델입니다. 하지만 실제 제작에서 더 중요한 질문은 HappyHorse가 얼마나 좋은가가 아니라, HappyHorse에 어떤 입력을 줄 것인가입니다.

많은 크리에이터와 마케팅 팀에게 가장 안정적인 답은 간단합니다.

GPT Image 2로 움직일 가치가 있는 프레임을 만들고, HappyHorse로 그 프레임을 움직이세요.

HappyHorse가 GPT Image 2보다 더 좋은가요?

서로 다른 도구입니다. GPT Image 2는 이미지 생성과 편집에 사용하고, HappyHorse는 영상 생성에 사용합니다. 실무에서는 GPT Image 2를 첫 프레임과 참조 이미지 준비 단계로 쓰고, HappyHorse를 모션 단계로 쓰는 편이 자연스럽습니다.

HappyHorse에서 text-to-video와 image-to-video 중 무엇을 써야 하나요?

자유롭게 아이디어를 탐색할 때는 text-to-video가 좋습니다. 제품, 캐릭터, 구도, 첫 프레임을 안정적으로 유지해야 한다면 image-to-video가 더 적합합니다.